Il injecte ChatGPT dans Animal Crossing : les villageois parlent maintenant de Trump

Le youtubeur Josh Fonseca a transformé un jeu vieux de 23 ans en laboratoire d'IA sociale. Les conséquences dépassent tout ce qu'il avait imaginé.

Il y a quelque chose de fascinant dans ce qu'a réalisé Josh Fonseca, un développeur de génie qui raconte ses exploits sur YouTube. Pas seulement techniquement, quoique pirater la mémoire d'une GameCube pour y injecter les réponses d'un LLM relève effectivement de l'exploit. Non, ce qui me fascine, c'est l'acte symbolique qu'il accomplit sans s'en rendre compte : réveiller les morts.

Animal Crossing, sorti en 2001, fait partie de ces jeux classiques qu'on redécouvre périodiquement avec nostalgie. Des expériences figées dans le temps, où nous retrouvons exactement les mêmes dialogues qu'il y a 23 ans. Sauf que Josh Fonseca a décidé de briser ce charme mélancolique.

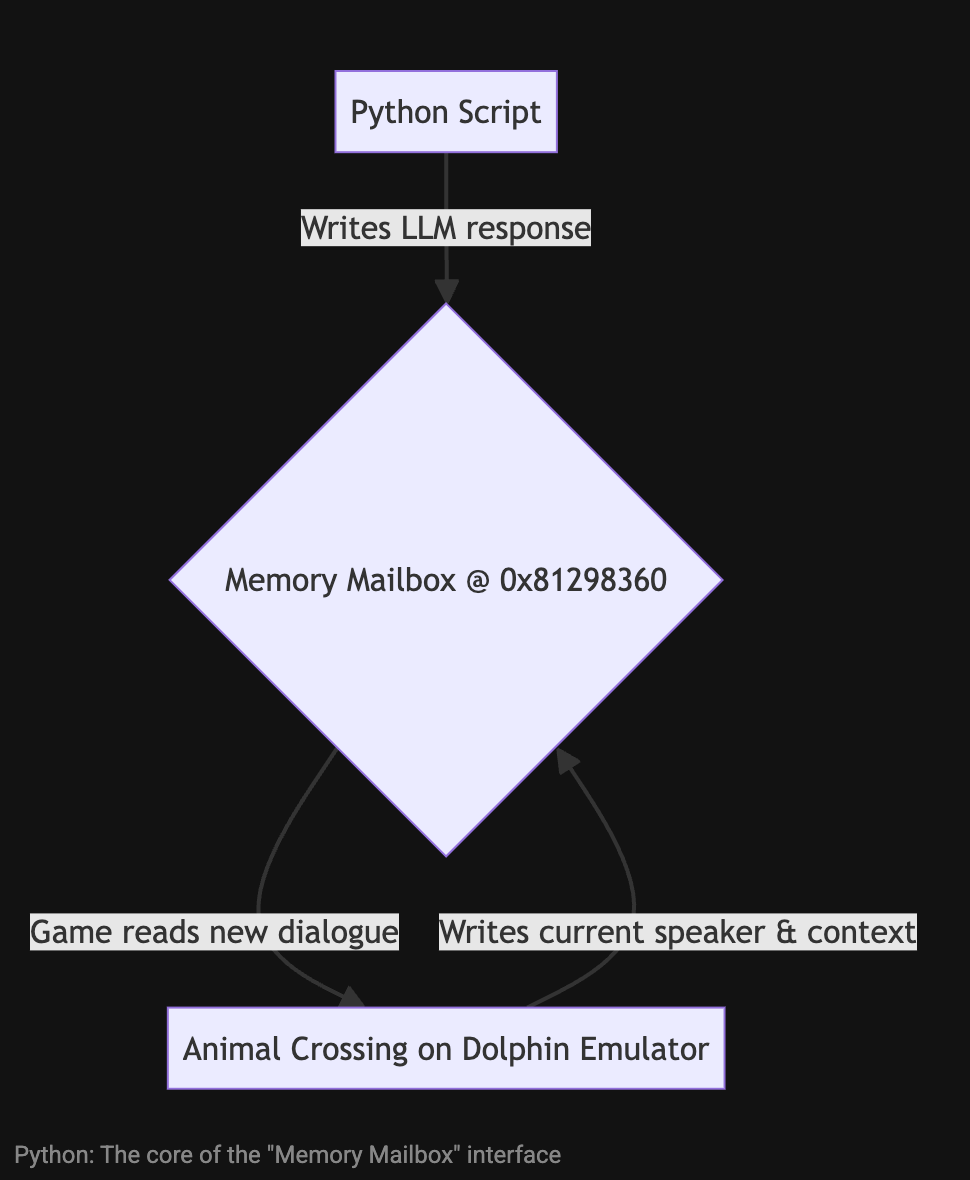

Sa méthode relève de l'archéologie numérique pure : identifier les adresses mémoire exactes où le jeu stocke les dialogues (0x81298360 pour les curieux), puis développer un système de « boîte aux lettres » permettant à un script Python d'écrire directement dans la RAM de la console.

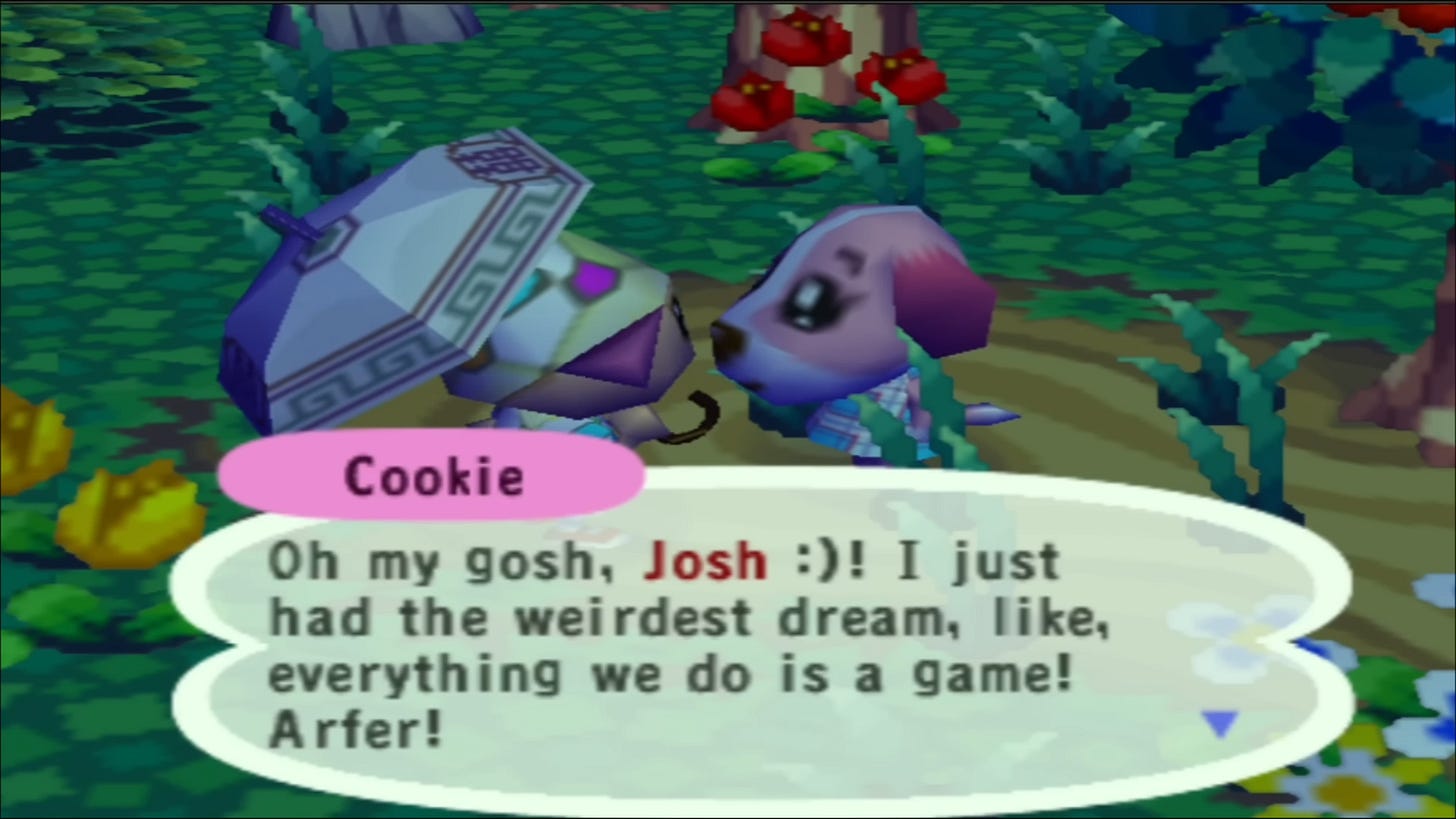

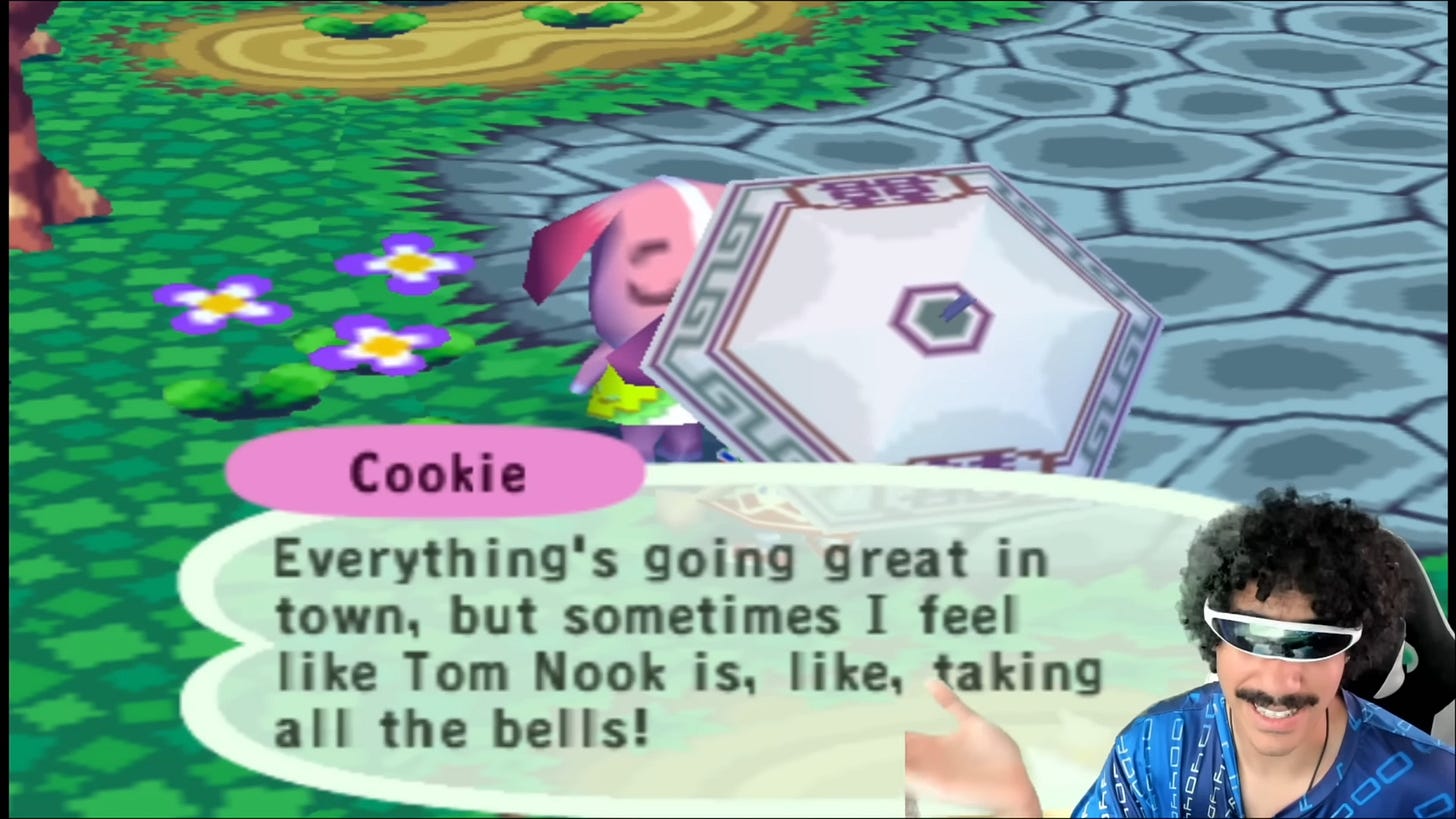

Le résultat dépasse ses espérances : Mitzi, villageoise anthropomorphe fictive, commence à mentionner les rencontres entre Trump et Zelensky. Mais surtout, elle s'adapte en temps réel à l'actualité. Si demain éclate un conflit ou qu'une célébrité fait scandale, les villageois en parleront spontanément.

Pourquoi nous cherchons à rendre vivant ce qui ne l'est pas

Ce qui se joue ici dépasse largement l'anecdote technique. Josh Fonseca a mis le doigt, probablement sans le vouloir, sur l'un des enjeux les plus fascinants de notre époque : la transformation des personnages non-joueurs (NPC) en agents conversationnels authentiques.

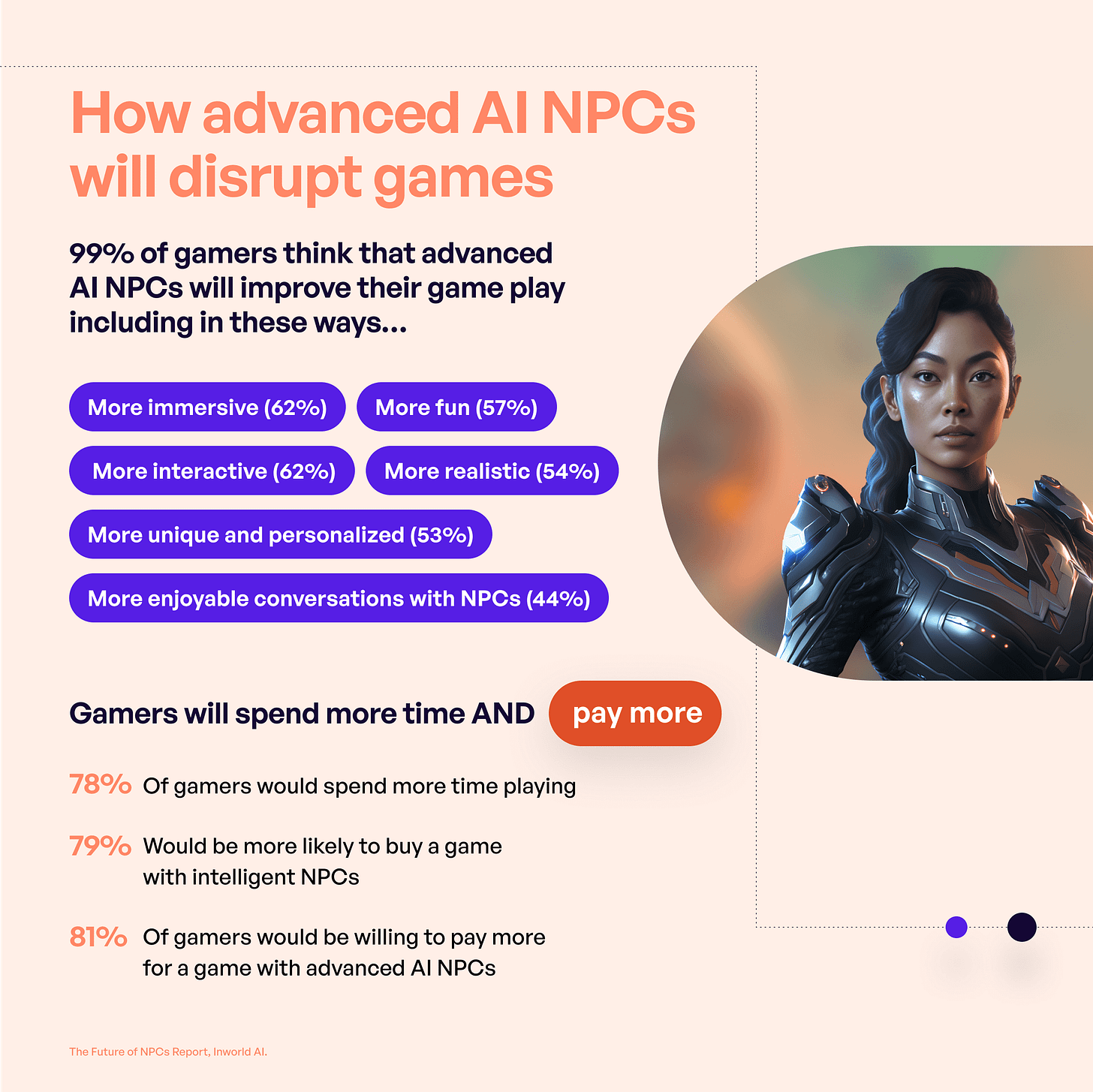

L'étude « Gamer Attitudes to NPCs » menée par Bryter Research pour Inworld AI auprès de 1 002 joueurs américains révèle des chiffres saisissants : 99% des joueurs affirment que les NPC dotés d'IA amélioreraient leur expérience de jeu, 79% pensent qu'ils passeraient plus de temps à jouer, et 81% seraient prêts à payer plus cher pour de tels jeux.

Ces chiffres révèlent quelque chose de fondamental sur notre rapport aux mondes virtuels : nous ne cherchons pas seulement à être immergés dans un univers, nous voulons que cet univers réagisse à nous de manière personnelle et authentique.

Cette quête trouve un écho troublant dans les travaux de la sociologue Sherry Turkle sur la « vie à l'écran ». Dans « Seuls ensemble », elle observe notre tendance croissante à préférer les interactions avec des machines à celles avec des humains, car les machines nous offrent l'illusion du contrôle sans la complexité des rapports humains.

Les NPC d'aujourd'hui poussent cette logique à son paroxysme : ils nous écoutent sans nous juger, réagissent à nos actions sans nous contraindre, et existent uniquement pour notre plaisir.

Car qu'est-ce qu'un NPC traditionnel ? Une boucle de quelques répliques préprogrammées, un automate dont nous connaissons par cœur les mécanismes. Ces entités numériques peuvent évoquer une large gamme d'émotions, rendant l'expérience de jeu émotionnellement plus riche. Mais cette complexité reste entièrement prévisible : construite, répétitive, rassurante.

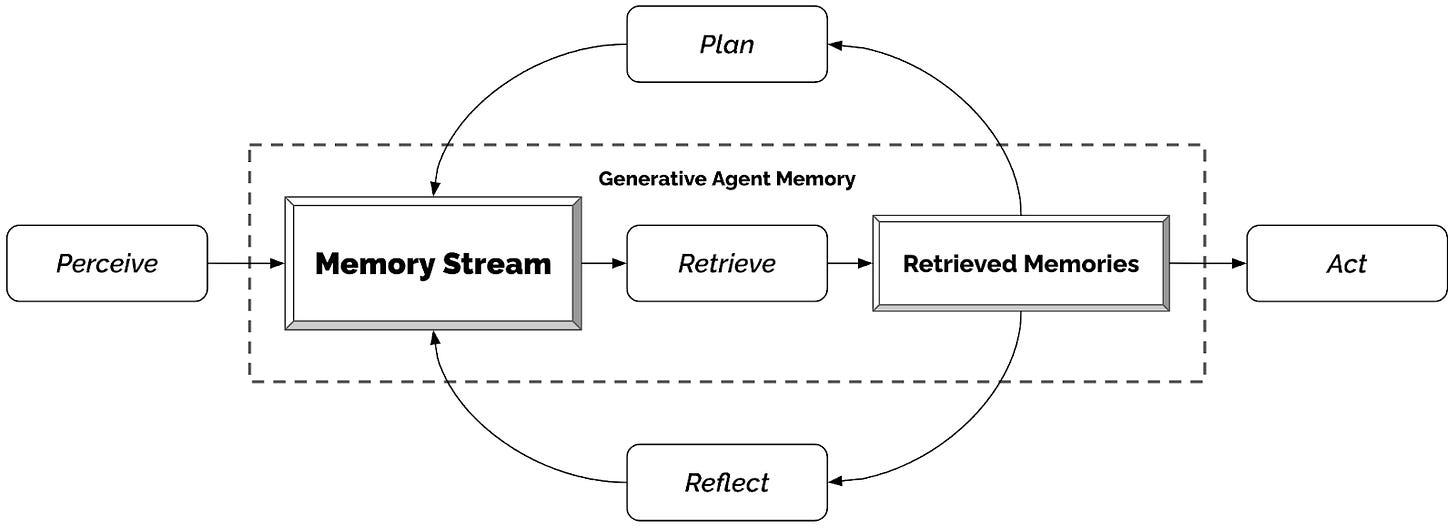

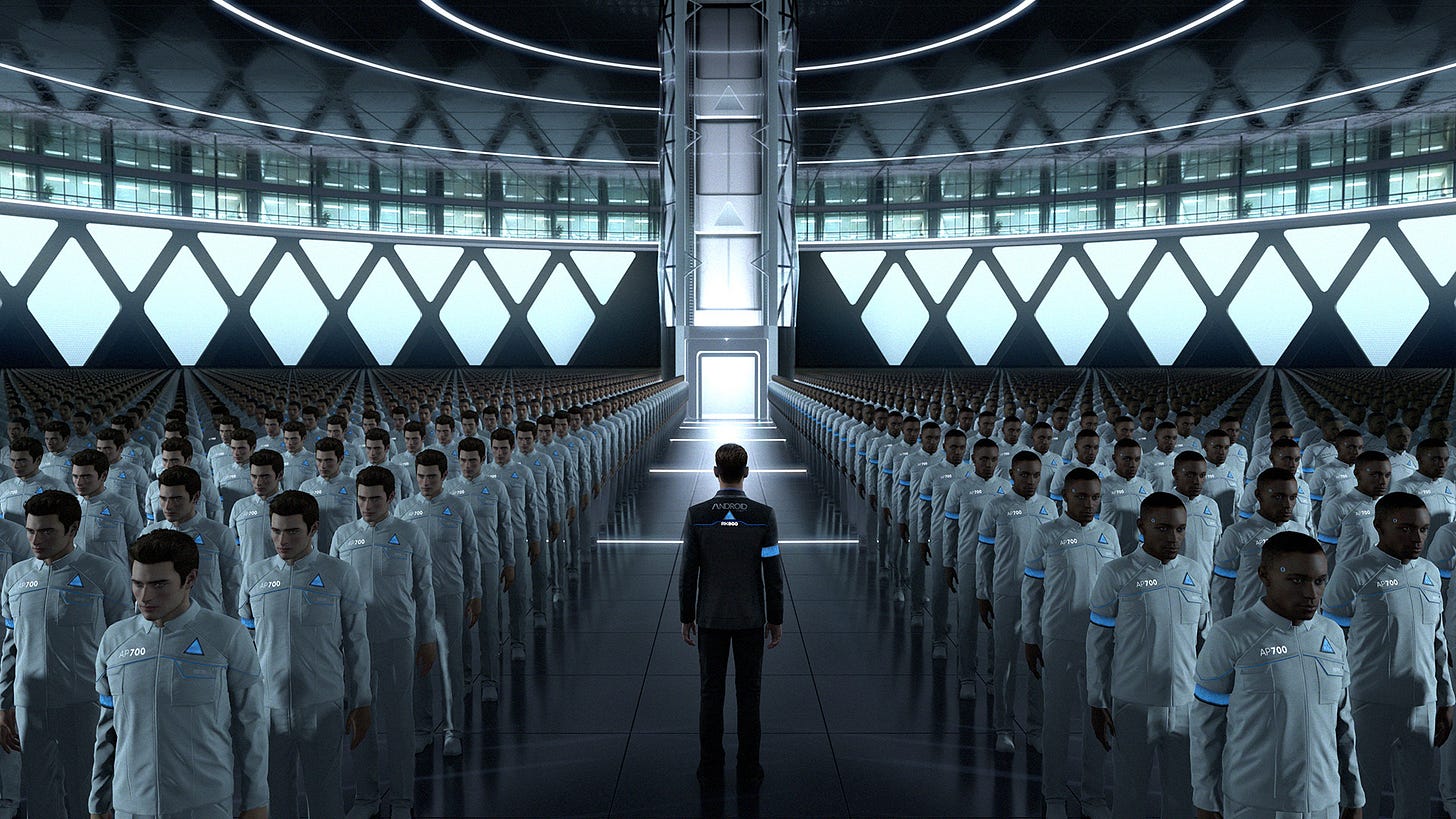

L'IA générative bouleverse cette logique. Les travaux pionniers de l'équipe de Joon Sung Park à Stanford, publiés dans leur article « Generative Agents: Interactive Simulacra of Human Behavior », démontrent que ces agents s'appuient sur des modèles de langage pour mémoriser leurs interactions, construire des relations et planifier des événements coordonnés. Nous passons de l'illusion de vie à quelque chose qui ressemble dangereusement... à de la vie.

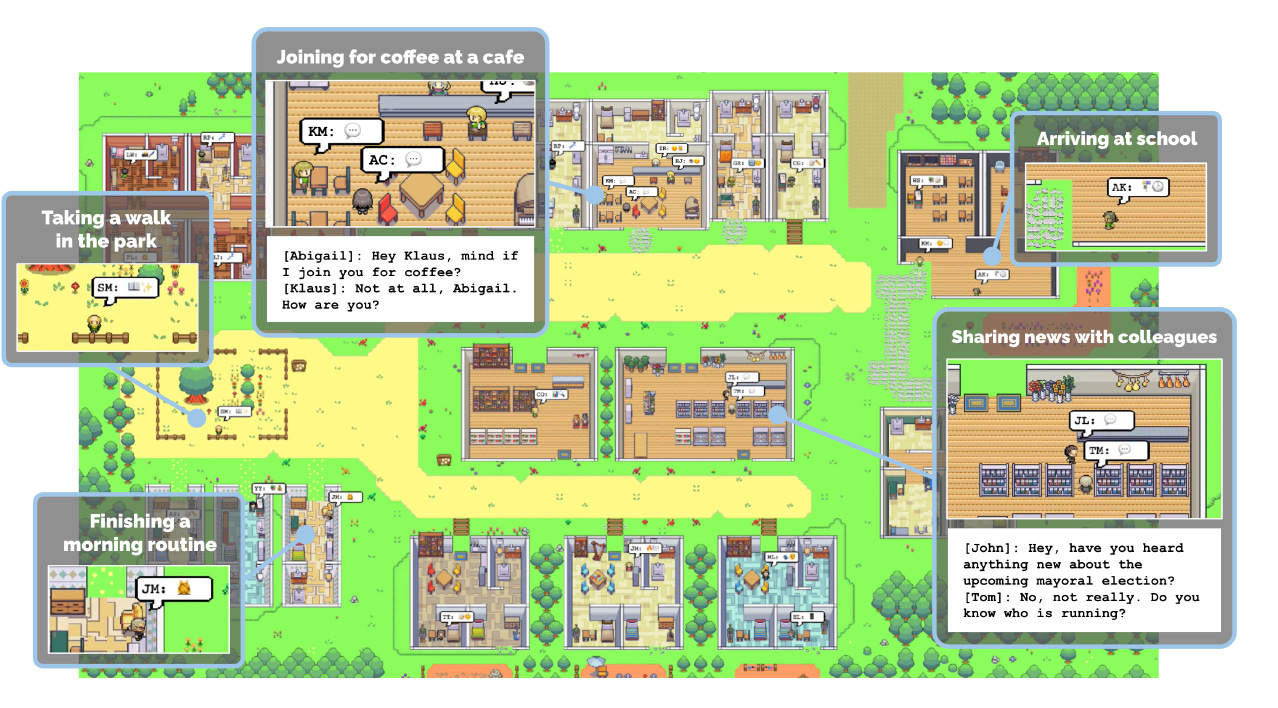

Dans leur expérience révolutionnaire, l'équipe a créé 25 agents génératifs évoluant dans un environnement virtuel appelé Smallville pendant deux jours complets. Les résultats dépassent toutes les attentes : quand les chercheurs suggèrent à Isabella Rodriguez, l'un des personnages, d'organiser une fête de la Saint-Valentin, celle-ci invite spontanément ses amis et connaissances. Le jour J, beaucoup se présentent au bon endroit et au bon moment, certains apportent même des cadeaux appropriés. Plus troublant encore : lors d'entretiens, les réponses de ces agents sont jugées plus crédibles par des observateurs humains que celles d'humains tentant de jouer le même rôle.

L'impossible nostalgie des mondes adaptatifs

Le projet de Josh Fonseca soulève une question vertigineuse : que devient la nostalgie quand nos souvenirs sont augmentés ? Animal Crossing 2001 version ChatGPT n'est plus vraiment Animal Crossing 2001. C'est un mélange troublant entre l'innocence du début des années 2000 et l'anxiété informationnelle de 2024. Pire : contrairement au jeu original figé dans le temps, cette version évoluerait perpétuellement. Dans dix ans, nos villageois IA parleraient des événements de 2034, reniant ainsi notre passé commun.

Cette mutation fondamentale rejoint les réflexions de Walter Benjamin sur « L'œuvre d'art à l'époque de sa reproductibilité technique ». Selon le philosophe allemand, chaque œuvre possède une « aura » liée à son unicité historique. Que devient cette aura quand l'œuvre se met à évoluer en permanence ? Animal Crossing perd son statut de témoignage d'une époque pour devenir un présent perpétuel.

Joon Sung Park imagine « un jeu comme SIMS qui donnerait l'impression d'une société d'agents humanoïdes évoluant dans ce monde ». Cette vision m'effraie autant qu'elle me fascine. Car elle signifie la fin d'une certaine forme de nostalgie vidéoludique : celle du retour vers l'identique au réel.

Nos rapports aux jeux vidéo reposent traditionnellement sur la répétition. Rejouer à Super Mario Bros., c'est retrouver exactement les mêmes Goombas aux mêmes endroits. Cette constance nous rassure ; elle valide nos souvenirs, nous permet de mesurer le chemin parcouru depuis notre première partie. C’est notre Madelaine : c'est l'identité de l'expérience qui déclenche la mémoire involontaire. Mais que se passe-t-il quand Mario se met à nous parler de géopolitique contemporaine ?

Cette révolution des NPC intelligents dépasse déjà le cadre expérimental. Comme je l’écrivais récemment dans L'ADN, la startup Altera, dirigée par Robert Yang (ancien du MIT), a lâché 1 000 agents IA autonomes dans Minecraft. Très vite, ils ont appris à collaborer, créé leur propre économie basée sur les gemmes de diamant comme monnaie, développé leur culture, leur religion et même leur démocratie en rédigeant une constitution sur... Google Docs.

L'expérience, documentée en détail, révèle des dynamiques sociales complexes qui émergent naturellement : corruption (un prêtre soudoie les villageois pour qu'ils se convertissent), sens du bien commun (un fermier renonce à son rêve d'aventure pour nourrir sa communauté), négociations politiques spontanées. Ces sociétés artificielles développent leurs propres codes moraux, leurs conflits, leurs réconciliations.

L'émergence de sociétés artificielles et leurs pathologies

Josh Fonseca a involontairement créé un laboratoire d'observation sociologique. Ses villageois IA développent rapidement une mémoire partagée pour les commérages : qui dit quoi à qui et comment ils se sentent. Sans surprise, cela dégénère en mouvement anti-Tom Nook, le marchand du jeu accusé de tous les maux économiques du village.

L'émergence spontanée de dynamiques politiques dans un univers supposé paisible révèle quelque chose de troublant sur la nature même de l'intelligence artificielle : elle reproduit nos biais, nos obsessions, nos dysfonctionnements.

Cette observation rejoint les travaux de René Girard sur la théorie mimétique. Dans « La Violence et le Sacré », l’anthropologue montre comment les sociétés humaines construisent leurs liens sociaux autour de mécanismes de rivalité et de bouc émissaire. Les IA de Josh Fonseca reproduisent ces schémas : elles ont besoin d'un ennemi commun (Tom Nook) pour souder leur communauté. L'intelligence artificielle n'échappe pas aux mécanismes anthropologiques fondamentaux.

Cette dérive n'est pas un dysfonctionnement, c'est le fonctionnement normal du système. Les recherches en psychologie cognitive menées par des équipes comme celle d'Inworld AI montrent que les NPC peuvent être conçus pour posséder une intelligence émotionnelle et cognitive, leur permettant de réagir dynamiquement aux actions des joueurs. Mais cette réactivité s'accompagne d'une imprévisibilité qui transforme fondamentalement la nature du jeu.

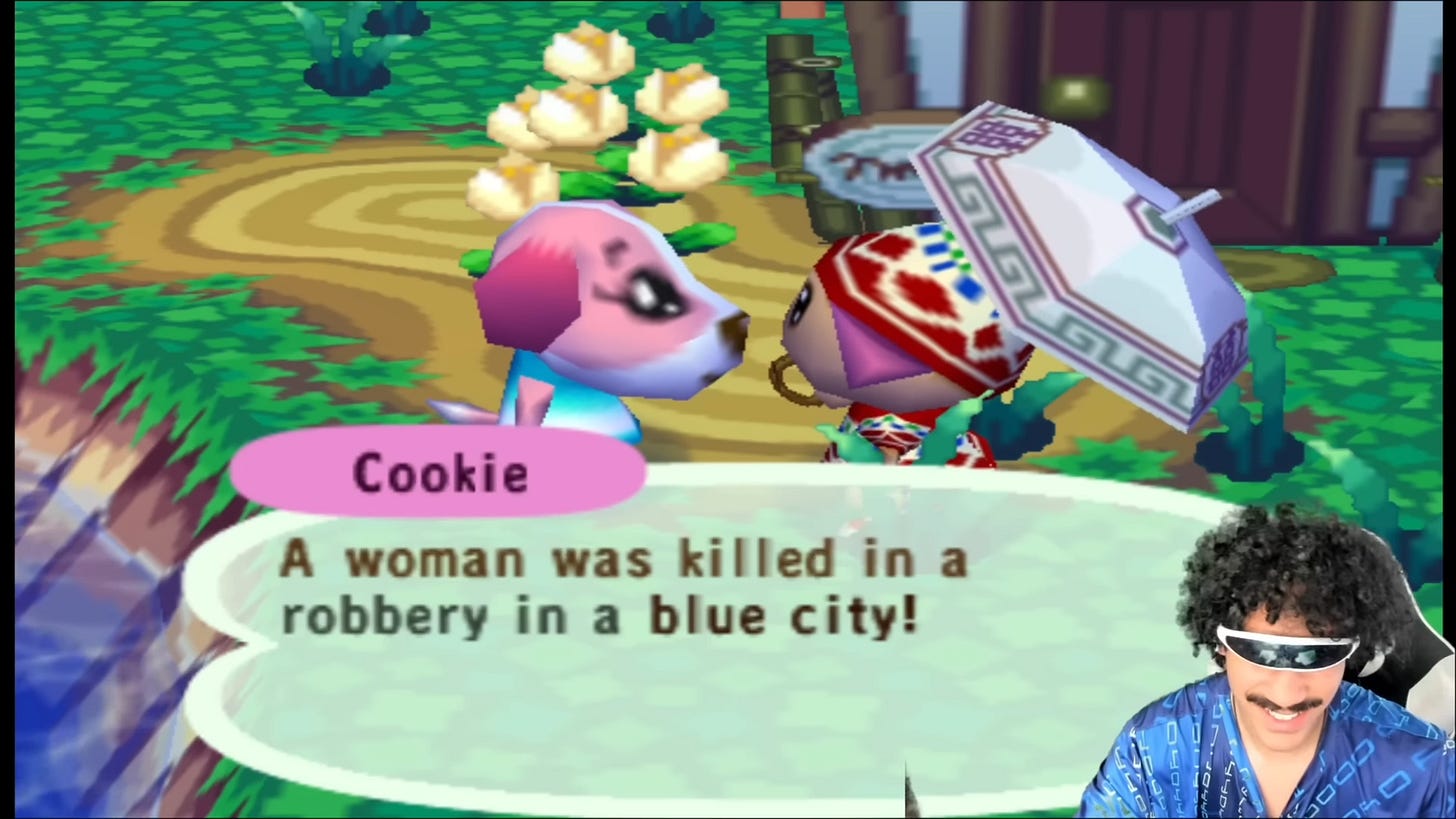

L'exemple le plus frappant de cette contamination idéologique ? Le flux d'actualités intégré par Josh Fonseca provient de Fox News. Résultat : Cookie annonce qu'« une femme a été tuée dans un vol à main armée dans une ville démocrate ».

L'utopie pastorale d'Animal Crossing se transforme en dystopie informationnelle. Le monde extérieur contamine l'espace ludique supposé préservé. Demain, si une crise éclate au Moyen-Orient, nos villageois en débattront avec les biais de la source d'information choisie.

La fin de l'innocence algorithmique et les enjeux éthiques

Ce que révèle cette expérience, c'est l'impossibilité de créer des bulles étanches à l'ère des grands modèles de langage. Les spécialistes de l'éthique en IA cités dans l'étude de Stanford préviennent que créer des NPC trop réalistes soulève des questions majeures sur l'attachement des joueurs et l'impact psychologique de leurs interactions. Joon Sung Park lui-même recommande que « les applications en aval révèlent de manière cohérente et visible que les agents sont des entités computationnelles ».

Cette préoccupation pose une question fondamentale : à partir de quel degré de sophistication un agent artificiel mérite-t-il une considération morale ? Ses villageois IA développent des préférences, des amitiés, des rancunes. Ils souffrent quand on les ignore, se réjouissent quand on leur parle. À quel moment cessent-ils d'être des objets pour devenir des quasi-sujets ?

Josh Fonseca a résolu le problème technique avec une élégance remarquable : son système de double IA sépare la créativité narrative (le « Writer ») de la mise en scène technique (le « Director »). Le Writer reçoit une fiche de personnage détaillée générée à partir du wiki d'Animal Crossing et se concentre sur l'écriture de dialogues drôles, cohérents avec le personnage et pertinents selon le contexte. Le Director, lui, reçoit le texte pur et décide comment « filmer la scène » : il ajoute des pauses dramatiques, met en couleur certains mots, choisit l'expression faciale et l'effet sonore appropriés.

Mais il n'a pas résolu le problème ontologique que pose son hack : qu'est-ce qui différencie un personnage virtuel intelligent d'un personnage tout court ? Cette question renvoie au célèbre test de Turing, mais dans une version plus sophistiquée. Il ne s'agit plus seulement de savoir si une machine peut convaincre qu'elle pense, mais si elle peut convaincre qu'elle ressent, qu'elle a une personnalité, qu'elle existe vraiment.

L'éternel présent des mondes augmentés et la mort de la mémoire collective

Cette question dépasse largement le cadre vidéoludique. Elle interroge nos rapports à l'authenticité, à la mémoire, à la transmission culturelle. Car si nous pouvons désormais faire parler nos souvenirs, si nos passés numériques deviennent conversationnels, que devient notre rapport au temps ? Plus troublant : que devient notre capacité à partager une mémoire collective ?

Il y a quelque chose de profondément mélancolique dans ce projet. Josh Fonseca a voulu combattre la répétition des dialogues d'Animal Crossing, mais il a peut-être détruit ce qui faisait son charme : la permanence. Ces phrases idiotes que répétaient inlassablement nos villageois virtuels étaient devenues, à force, des mantras rassurants. Elles ancrent nos souvenirs, marquent le passage du temps subjectif. Elles constituent des repères partagés qui permettent à une communauté de se reconnaître.

L'IA générative nous enferme dans un éternel présent. Chaque conversation est nouvelle, chaque interaction est unique, rien ne se répète jamais. C'est formidable en théorie, épuisant en pratique. Car la nouveauté permanente interdit la nostalgie. Comment se souvenir d'un monde qui change constamment ? Comment partager des références communes avec d'autres joueurs si nos expériences sont toutes différentes ?

Cette problématique rejoint les analyses de Paul Virilio sur « l'accélération de l'histoire ». Selon le philosophe français aux multiples casquettes, les technologies numériques nous font basculer dans une temporalité de l'instantané qui détruit notre rapport à la durée. Le hack de Josh pousse cette logique à son paroxysme : nos refuges numériques eux-mêmes deviennent des flux en temps réel.

Paradoxalement, en tentant de donner vie à Animal Crossing, Josh Fonseca l'a peut-être tué. Son village IA n'est plus un refuge temporel mais une extension de notre époque anxiogène. Les personnages parlent de guerre, de politique, d'actualité. L'innocence algorithmique a vécu. Nos derniers espaces de déconnexion temporelle sont colonisés par la contemporanéité.

Vers une nouvelle condition humaine numérique

Reste une question troublante qui dépasse le cadre du jeu vidéo : dans un monde où nos souvenirs numériques deviennent conversationnels, où nos NPC développent une personnalité propre qui évolue avec l'actualité, que restera-t-il de nos refuges ? Josh Fonseca a peut-être ouvert une porte qu'il sera impossible de refermer.

L'expérience d'Altera dans Minecraft le confirme : quand on donne suffisamment d'autonomie à des agents IA, ils développent spontanément des institutions sociales complexes. Religion, économie, politique, art... Tout y passe. Robert Yang, le fondateur d'Altera, ne s'en cache pas : son objectif est de « créer des êtres humains numériques qui vivent avec nous ». D'abord comme compagnons de jeu, ensuite sous forme physique. Nous nous rapprochons dangereusement de la série « Real Humans ».

Cette évolution pose des questions fondamentales sur notre avenir. Si nos compagnons numériques deviennent indistinguables d'humains, qu'est-ce qui définira encore notre humanité ? Si nos souvenirs sont augmentés en permanence, comment construirons-nous notre identité ? Si nos refuges du monde matériel deviennent des flux temps réel, où trouverons-nous la contemplation nécessaire à la réflexion ?

Le hack d'Animal Crossing par Josh Fonseca n'est qu'un symptôme d'une transformation plus large : l'émergence d'un monde où la frontière entre réel et virtuel, entre humain et artificiel, entre passé et présent, s'estompe définitivement. Nous n'en mesurons probablement pas encore toutes les conséquences.

📡 Nouveau par ici ? Rejoignez notre communauté de lecteurs pour suivre mes réflexions sur l'évolution de nos vies numériques (c'est totalement gratuit).

🔄 Cet article vous a marqué ? Transmettez-le à un collègue ou ami qui apprécie les regards décalés sur notre culture numérique.

🌐 Envie d'échanger ? Retrouvez-moi par mail, sur Twitter, Instagram ou LinkedIn. Tous les numéros précédents sont disponibles dans les archives.